Inteligencia artificial, qué gran error haber pensado que se trataba de producir por medios artificiales los “efectos de inteligencia” de un pensador natural, de una inteligencia humana -en toda su decepción-. Hay un desafío mucho más alto e interesante, y es el que está aquí en juego -y es el que siempre ha animado la investigación en autómatas, en teatros de la memoria, en inteligencias artificiales-: poner en operación mecanismos y dinámicas capaces de producir, para sí, efectos de comprensión en el espacio tensional de una red de conexiones abiertas, una máquina social, un enjambramiento multitudinario de enlaces reenviados que conforma el puro momento holístico, la ecuación vectorial, de un sistema de fuerzas constelando.

Jose Luis BREA, Las tres eras de la imagen

Esta propuesta se basa en La cuarta era de la imagen y el surgimiento del problema: cuando las máquinas aprenden a ver. Esta cuarta era sintetiza ese giro político-crítico: la comprensión de la imagen contemporánea como un fenómeno atravesado simultáneamente por la creación artística, la operación algorítmica, la economía de datos y los problemas de representación que emergen cuando las máquinas aprenden a ver. En este contexto, la imagen ya no es únicamente un registro visual: es un nodo dentro de sistemas de captura, datificación, clasificación, vigilancia y predicción. La producción artística no puede desligarse de estos regímenes, pues participa y es afectada por ellos.

Si aceptamos que la imagen contemporánea se constituye en un ecosistema donde humanos y no humanos co-producen visualidad, entonces es necesario examinar los modos de economía, vigilancia y circulación que estructuran esta cuarta era. El concepto de capitalismo de vigilancia resulta clave para comprender la magnitud de este giro: la imagen —convertida en dato— se vuelve materia prima para el entrenamiento de modelos algorítmicos y mecanismo de control operativo. La imagen ya no representa: funciona como combustible para infraestructuras de inteligencia artificial cuya escala excede cualquier marco artístico tradicional.

Este fenómeno tiene consecuencias directas en el campo del arte. En Colombia, por ejemplo, se promueve la idea de que “hacemos inteligencia artificial”, pero en realidad lo que se produce es mano de obra para alimentar las maquilas algorítmicas de corporaciones que centralizan los datos, los modelos y la regulación. La soberanía tecnológica desaparece, y junto con ella la capacidad de decidir qué se entrena, cómo se entrena y a quién beneficia. La imagen que aprende no está aislada de estos sistemas: está estructuralmente unida al régimen económico que la sostiene.

Este escenario explica por qué la investigación derivó en un proyecto final titulado Muerte de Redes Neuronales Artificiales. Si la cuarta era de la imagen se caracteriza por la acumulación infinita de datos, la autoprogramación y la ubicuidad absoluta, era necesario invertir la pregunta y tensionar el sistema desde dentro: ¿qué ocurre si, en lugar de entrenar una máquina para aprender, la entrenamos para olvidar? ¿Qué significa el olvido en un sistema cuya razón de ser es almacenar, replicar y expandir información visual?

Aquí la pregunta deja de ser técnica y se vuelve estética y política. Olvidar —eliminar datos— es un acto radical en un entorno donde todo está orientado a la captura total. La cultura del dato no concibe el olvido como posibilidad; de hecho, lo borra como categoría. Y sin embargo, en lo humano, el olvido es constitutivo: permite vivir, permite sanar, permite desaparecer huellas que no deberían ser permanentemente retenidas.

En esta primera parte se define, por tanto, el problema central del proyecto:

cómo pensar, producir y experimentar imágenes en una era donde las máquinas no solo ven, sino que aprenden, recuerdan, acumulan y operan bajo lógicas de control; y cómo interrumpir esas lógicas desde una práctica artística que introduce el olvido como gesto crítico.

La experimentación: entrenar una máquina para olvidar

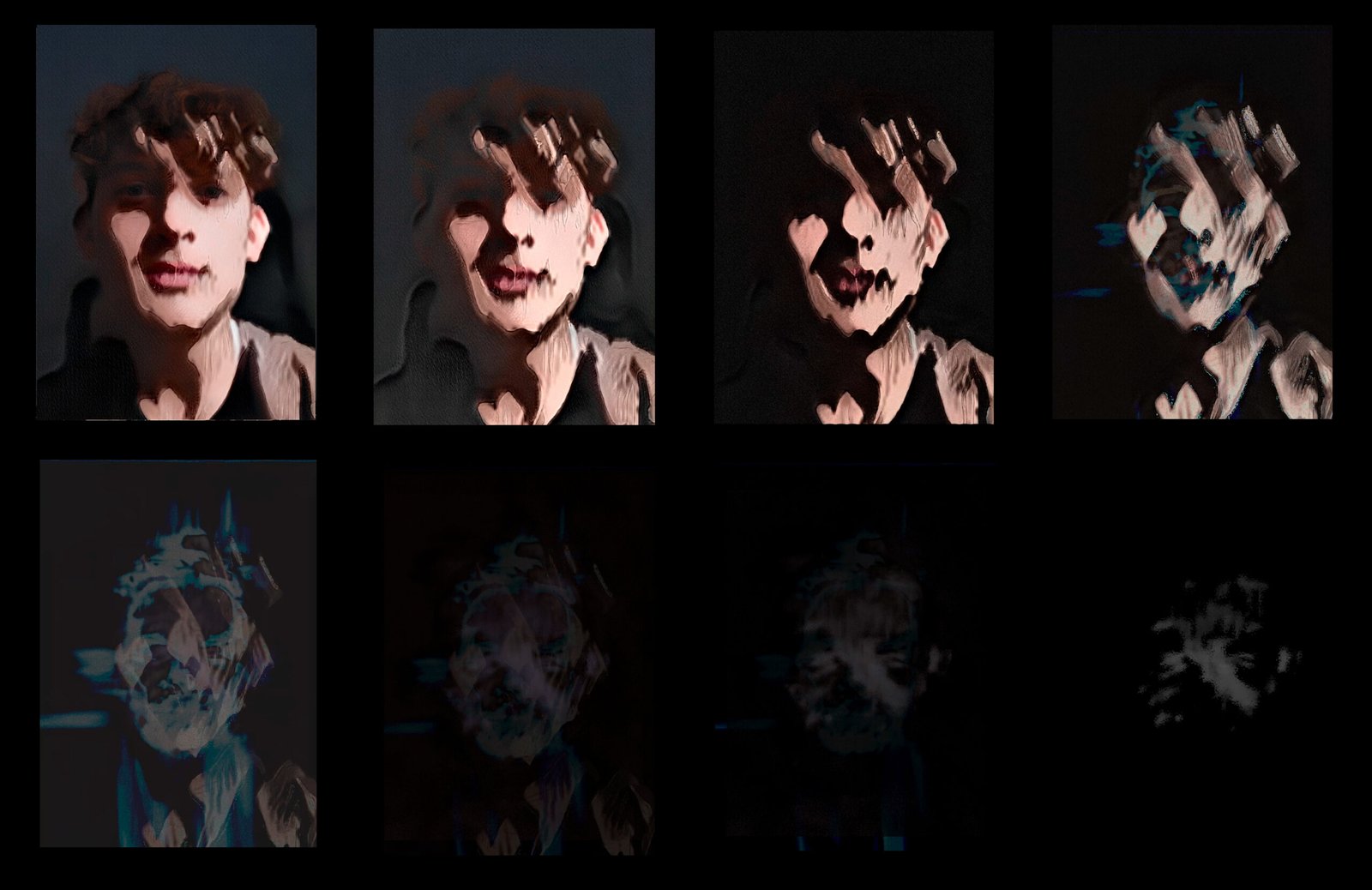

Esta propuesta se basa en la reproducción de una metáfora sobre la muerte de las redes neuronales artificiales. Para construirla, se modeló una inteligencia artificial entrenada no para aprender más, sino para olvidar: eliminar información previamente adquirida durante su proceso de entrenamiento. Se diseñó así un sistema capaz de desgastar sus propios valores estadísticos de conformación de la imagen hasta llevarlos a un estado de mínima información. El resultado: la imagen se degrada en su forma, se fragmenta y finalmente desaparece.

El procedimiento revela un punto decisivo:

cuando la IA elimina datos, su visualidad entra en un proceso de deterioro que se aproxima metafóricamente a la muerte humana, dejando en la imagen un rastro del desgaste, una suerte de residuo visual comparable al deterioro del rostro al morir. Es un tipo de olvido algorítmico que se manifiesta estéticamente a través de la pérdida progresiva de coherencia, color y estructura.

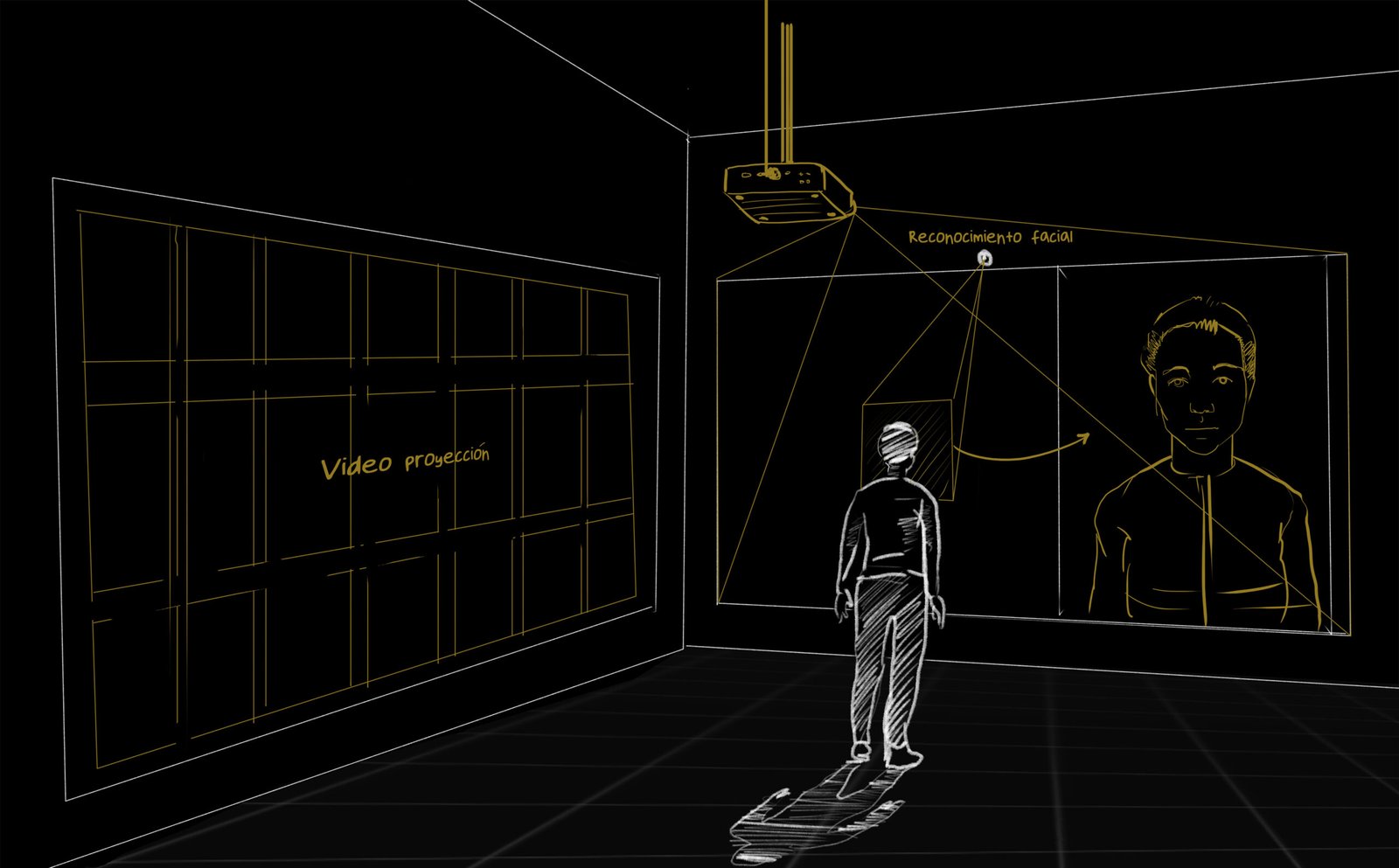

El proyecto funciona como instalación interactiva. El visitante ingresa en una sala donde encuentra:

— una retícula de rostros previamente olvidados por la IA,

— un marco de captura mediante herramientas de reconocimiento facial,

— y una proyección que muestra el proceso completo del deterioro de su imagen.

La imagen del visitante es capturada en tiempo real, procesada por la IA y mostrada mientras está siendo degradada. Una vez el olvido se completa, esa imagen pasa a integrar la retícula de rostros ya olvidados, convirtiéndose en otro fragmento de la memoria extinguida de la máquina.

El gesto es radical porque introduce una operación que contradice la lógica del sistema:

la IA, diseñada para acumular y expandir información, es forzada a olvidar.

Mientras los modelos contemporáneos se basan en la retención infinita —alimentados por millones de imágenes invisibles que no vemos, pero que sostienen su funcionamiento— este proyecto propone lo contrario:

eliminar, desgastar, borrar, vaciar.

Esto expone la fragilidad del régimen de la imagen en la era algorítmica:

una vez almacenados, nuestros rostros, huellas digitales y patrones visuales continúan existiendo en sistemas opacos, inaccesibles y no auditables. La muerte de una red neuronal plantea la pregunta por la posibilidad del olvido en un sistema que no contempla esa opción.

Se describe, así, la dimensión técnica-poética del proyecto, un acto performativo donde la imagen, al ser procesada por la IA, atraviesa su propio proceso de desaparición.

Olvido, agencia maquínica y crítica al capitalismo de vigilancia

La intención de esta propuesta es abrir una reflexión sobre la administración de datos en la inteligencia artificial y sobre las formas en que estas máquinas están siendo entrenadas bajo lógicas de acumulación absoluta. Este modelo —propio del capitalismo de vigilancia— concibe la información humana como materia prima, no como experiencia. Y cuando la experiencia es reducida a dato, no existe posibilidad de olvido, de desaparición ni de borrado: todo queda retenido, procesado y redistribuido sin control humano real.

El proyecto tensiona esa lógica al introducir un gesto que la IA no contempla: desaprender.

Forzar a una máquina a olvidar implica cuestionar de raíz el paradigma que sostiene su diseño: la idea de que su valor depende de acumular más información, analizar más datos y aumentar su poder predictivo. En contraste, el olvido revela la fragilidad del sistema y evidencia que ciertas funciones esenciales para la vida humana —el silencio, la pérdida, la desaparición— no tienen lugar en las arquitecturas algorítmicas actuales.

La instalación también dialoga con la dimensión antropocéntrica del desarrollo tecnológico. Gran parte de la ingeniería y la ciencia computacional se ha basado en analogías con el cerebro humano, el aprendizaje por refuerzo, las redes neuronales y los modelos cognitivos. Estas referencias, tomadas de la neurociencia y la pedagogía, han moldeado la manera en que imaginamos las máquinas y alimentan la fantasía de que producirán creatividad, autonomía o pensamiento. Pero la IA no es una mente; es un sistema entrenado con decisiones humanas, sesgos humanos, datos humanos.

Las prácticas artísticas permiten entonces desarmar esta ilusión de neutralidad y exponer que la IA se construye sobre prejuicios culturales y estructuras de poder. No es un agente objetivo; es una arquitectura técnica inscrita en condiciones sociales, políticas y económicas específicas.

Por eso resulta urgente desmontar la noción de progreso técnico lineal y abrir un diálogo no imitativo con la máquina. Desplazarnos hacia formas de cooperación humano–máquina que no requieran más potencia computacional, sino sensibilidad, intuición, normas culturales y disposiciones afectivas que emergen del encuentro. Este proyecto propone precisamente ese desplazamiento: pensar una máquina que pueda desaprender, en lugar de ser diseñada únicamente para evolucionar y superarse.

A ello se suma que la producción de proyectos con IA requiere trabajar con códigos fuente y bases de entrenamiento creadas en contextos ya condicionados por hegemonías sociales y políticas. Las máquinas pueden recopilar volúmenes infinitos de datos y generar patrones que luego quedan fuera de nuestro control: rostros invisibles, huellas digitales, gestos capturados sin consentimiento, imágenes almacenadas que ya no podemos ver. La mayoría de estos sistemas no son transparentes: están sesgados y operan como dispositivos de poder.

Zuboff señala que el “pecado original” del capitalismo de vigilancia es la desposesión de la experiencia humana. Esa desposesión no es metáfora: es una práctica operacional concreta mediante la cual la experiencia es reclamada como recurso y convertida en dato. El aparato de la ubicuidad no solo observa: crea sus propios depósitos de información, expande sus archivos invisibles y regula nuestras interacciones en tiempo real. Lo que los científicos llaman accionamiento —la capacidad de modificar comportamientos instantáneamente— representa hoy un punto de inflexión.

Por eso la pregunta que plantea este proyecto es urgente:

¿cómo pedir ser olvidados? ¿Cómo recuperar la posibilidad de borrar nuestras huellas digitales? ¿Cómo ejercer agencia sobre nuestra propia imagen en un sistema que no contempla la desaparición?

“Muerte de Redes Neuronales Artificiales” invita a atravesar esa pregunta de manera experiencial: al ver nuestra propia imagen degradarse, fragmentarse y desaparecer, se revela aquello que la IA no permite en su diseño original. Y nos obliga a reconocer que la imagen plasmática —aquella imagen viva, energética y transformativa de la cuarta era— no solo produce el mundo, sino que también debe aprender a soltarlo.

En síntesis, la obra propone una ética del olvido para una época obsesionada con recordar.

Julio – Diciembre 2023